DIENSTAG | 17. MÄRZ | 19 UHR | FPC, ULMENSTR. 20, 60325 FRANKFURT

ZU GAST

● Dr. Ronny Fritsche (COTO Leica Camera AG)

● Michael Gottschalk (Head of Content, dpa picture alliance)

● Prof. Christian Schemer (Teil der Forschungsgruppe „Mainzer Langzeitstudie Medienvertrauen“, Institut für Publizistik der Johannes Gutenberg-Universität Mainz)

MODERATION

● Jana Sauer (Präsidentin des Frankfurter PresseClubs)

„The World deserves Witnesses“ – und wie KI das Vertrauen in die Medien erschüttert

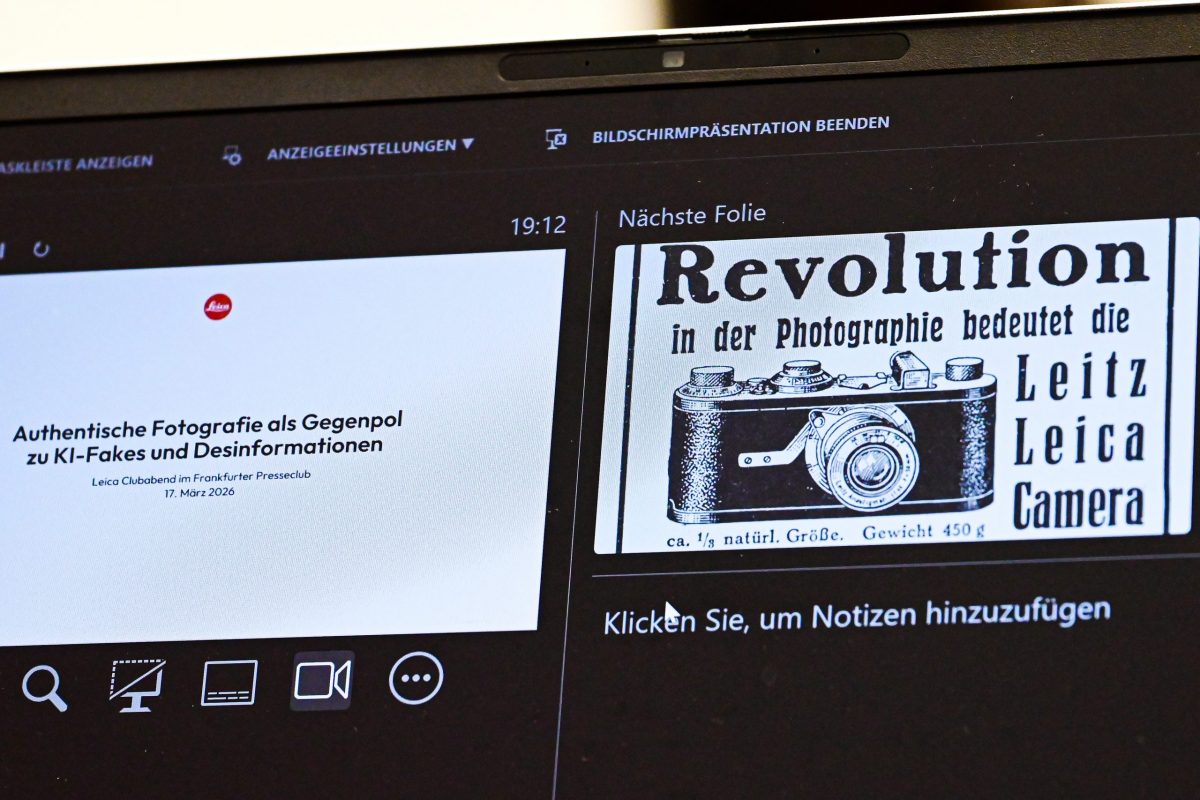

Frankfurt. – Ein volles Haus im Frankfurter PresseClub, ein Thema von wachsender Brisanz: Wie verändert Künstliche Intelligenz das Vertrauen in Medien – und insbesondere in Bilder? Über eine Entwicklung, die das Fundament medialer Glaubwürdigkeit berührte, diskutierten Expertinnen und Experten aus Technik, Journalismus und Wissenschaft zum Thema „Authentische Fotografie als Gegenpol zu KI-Fakes und Desinformationen“.

Schon zu Beginn machte FPC-Präsidentin und Moderatorin Jana Sauer deutlich, worum es ging: um nichts weniger als die Frage, ob Bilder noch das leisten, was ihnen lange zugeschrieben wurde: nämlich die Realität abzubilden. Denn aktuelle Studien zeigen, dass Menschen kaum noch zwischen echten und KI-generierten Bildern unterscheiden können. Eine repräsentative Helmholtz-Studie aus dem Jahr 2024 hatte ein beunruhigendes Bild offenbart: Mehr als 3.000 Teilnehmende aus Deutschland, China und den USA scheiterten daran, KI-generierte Bilder zuverlässig von menschengemachten Inhalten zu unterscheiden – ein deutliches Zeichen dafür, wie sehr künstliche Intelligenz bereits unsere Wahrnehmung von Realität herausfordert.

Orientierung und Vertrauen gehen verloren

Der Mainzer Kommunikationswissenschaftler Prof. Dr. Christian Schemer zeichnete das Bild eines tiefgreifenden Umbruchs in unserer Mediennutzung: Nachrichten erreichen ihr Publikum immer seltener über klassische Kanäle, sondern viel fragmentierter, ausgespielt über Plattformen, soziale Medien oder spezifische Apps. „Das heißt, die einzelne Nachricht, die einzelnen Informationen, Bilder natürlich auch, sind häufig einfach dekontextualisiert, also losgelöst von ihrer eigentlichen Quelle.“ Die Folge: Orientierung gehe verloren – und somit auch Vertrauen. „Spätestens dann wird’s für Rezipienten schwierig zu beurteilen, welche Nachrichten stimmen, welche sind wahr, welche Bilder sind authentisch und welche sind fake?“, so Schemer. Bereits während seiner ersten Amtszeit stellte der amerikanische Präsident Donald Trump die journalistische Sorgfaltspflicht massiv auf die Probe – und plötzlich wuchs das öffentliche Interesse an Qualitätsjournalismus und sorgfältigem Fact-Checking spürbar. „Also, das war wirklich eine wichtige Zeit für den Journalismus, um zu zeigen, was Journalismus wert ist, und was Journalismus kann.“

Verantwortung für Redaktionen wächst

Die gute Nachricht ist, so Michael Gottschalk, Head of Content dpa Picture-Alliance, dass Journalisten nicht überflüssig werden. Aktuell richtet sich der Fokus auf die Fotografie aus dem Iran – einem Kontext, in dem nur wenige Agenturen auf gewachsene, belastbare Beziehungen zu Pressefotografen zurückgreifen können. „Da kommen Bilder aus allen möglichen, teilweise auch Regierungsquellen, die wir als Bildexperten einordnen und Quellen auf die Spur kommen, die zweifelhaft sind.“ Erfordere ein Sachverhalt eine vertiefte Analyse, kommt der dpa-Faktencheck zum Einsatz „Und das muss nicht unbedingt eine Fotografie oder ein Video sein, das kann auch ein Fake News Post sein, der verifiziert werden muss.“ Bildredaktionen sehen sich heute mit der anspruchsvollen Aufgabe konfrontiert, Authentizität nicht nur sicherzustellen, sondern auch nachvollziehbar sichtbar zu machen. Die Auswirkungen auf den Redaktionsalltag sind erheblich, denn täglich erreichen über 50.000 neue Bilder das Unternehmen. Für Gottschalk steht fest: In einer Zeit, in der Bilder immer leichter manipulierbar sind, braucht es klare journalistische Standards. Denn es geht längst nicht mehr nur um einzelne Medienhäuser, sondern um die Glaubwürdigkeit visueller Information insgesamt. Dennoch, „am Ende hilft oft der gesunde Menschenverstand.“

Bilder im Zwielicht

Wie zugespitzt die Lage ist, machte Dr. Ronny Fritsche, Vorstand für Operations und Technologie bei der Leica Camera AG, in seinem Impuls deutlich: Er positionierte authentische Fotografie als unverzichtbaren Gegenpol zu KI-generierten Fälschungen und gezielter Desinformation. „Viele Menschen können KI-generierte Bilder nicht mehr von echten Bildern unterscheiden“, stellte er fest – ein Befund, der die Rolle der Fotografie grundlegend infrage stellt. „Früher hat man gesagt: Ein Bild sagt mehr als tausend Worte, heute muss man immer öfter fragen: Wie echt ist denn eigentlich das Bild?“ Als Beispiel führte er ein vermeintliches Verhaftungsfoto des venezolanischen Präsidenten Nicolás Maduro an, das sich später als KI-generierte Fälschung entpuppte. Eine Bildanalyse von Global Fact Checking habe ergeben, dass das Bild so nicht echt ist.

Technologie als Teil der Lösung

Einen möglichen Ausweg sieht Fritsche in der Content-Credentials-Technologie. Für Leica ist Authentizität dabei nicht allein eine technische Frage, sondern Ausdruck eines klaren Werteverständnisses. „Leica war schon immer Pionier, und Glaubwürdigkeit ist für uns eine Herzensangelegenheit.“ Die Technologie ermöglicht es, Herkunft und Bearbeitung von Bildern transparent nachzuvollziehen: Bereits bei der Aufnahme werden die Bilddateien mit fälschungssicheren Metadaten versehen, die sämtliche Entstehungs- und Bearbeitungsschritte dokumentieren, so Fritsche. Wie Content Credentials in der Praxis funktionieren, zeigte anschließend Oliver Claas, Pressesprecher der Leica Camera AG und Sprecher der BdKom Landesgruppe Hessen/Rheinland-Pfalz/Saarland im Bundesverband der Kommunikatoren, während der Live-Demonstration.

„Künstliche Intelligenz böse? Menschengemachte Medien gut?“

„Gilt das mit Blick auf den Bildjournalismus tatsächlich – oder greifen solche Einschätzungen zu kurz?“, fragte die FPC-Präsidentin zum Abschluss in die Runde. Michael Gottschalk verwies darauf, dass KI längst auch wertvolle Anwendungen biete – etwa spezielle Services für Sehbehinderte in der dpa-Bilddatenbank. Gerade bei Beständen von 300 oder 400 Millionen Bildern eröffnen sie neue Möglichkeiten: Intelligente Systeme unterstützen dabei, Inhalte zu sortieren, passende Motive zu identifizieren und gezielt nach gewünschten Bildinhalten zu suchen. Schon vor dem Aufkommen von KI, betonte Professor Schemer, sei ein kritischer Umgang mit Informationen unerlässlich gewesen – unabhängig davon, ob sie visuell oder verbal vermittelt werden. „Das zeichnet medienkompetente Bürgerinnen und Bürger aus.“ Leica setze hier gezielt auf Aufklärungsarbeit, erklärte Dr. Fritsche. Allein im vergangenen Jahr habe man mehr als 60.000 Besucher, darunter zahlreiche Schulklassen, im Leitz-Park in Wetzlar empfangen. Im Rahmen solcher Formate gehe es darum, ein Bewusstsein dafür zu schaffen, dass nicht alles, was im Takt von 15 Sekunden auf TikTok sehe, tatsächlich echt, real oder glaubwürdig sei.

Soll KI-Content gekennzeichnet werden?

Am Ende des Abends kristallisierte sich eine zentrale Erkenntnis heraus: Die Frage nach Authentizität ist zur Kernfrage des Journalismus geworden. In einer Welt, in der Bilder zunehmend manipulierbar sind, bemisst sich Glaubwürdigkeit längst nicht mehr allein am Inhalt, sondern ebenso an seiner Überprüfbarkeit. Entsprechend groß ist das Interesse an Technologien, die Vertrauen in mediale Inhalte sichern und stärken.

Der Clubabend im Video

Foto © www.michaelagel.com

Foto © Michael Gottschalk

Foto © Petra A. Killick